当我们无法完成某项任务时,AI 是极好的。

但如果我们本来可以完成,却因为懒惰、追求更高生产力的压力或竞争而选择不做呢?

如果你和我一样,你一定被铺天盖地的信息轰炸着—人们用 AI 做各种酷炫的事情,比如为自己搭建应用程序或自动化日常生活。连 Andrei Karpathy 也加入了 vibe-coding 的潮流,他还每天都在使用 LLM。

把日常的苦差事交给能替我们完成一切的工具,确实令人兴奋。越来越多的系统承诺自动替我们写邮件、管理社交媒体、阅读文档、辅助编程。当 AI 真正帮我们每周节省数小时的辛苦劳作时,很难不对它心生爱意。

但我一直在思考一个问题:仅仅因为我们可以把这么多任务外包出去,就意味着我们应该这么做吗?

赋能

在 AI 领域工作了十年之后,我离开了正在构建的 LLM 微调平台,休息一下,着手做那些搁置已久的项目。随着 AI 降低了快速取得实质性进展的门槛,这些项目终于变得触手可及。

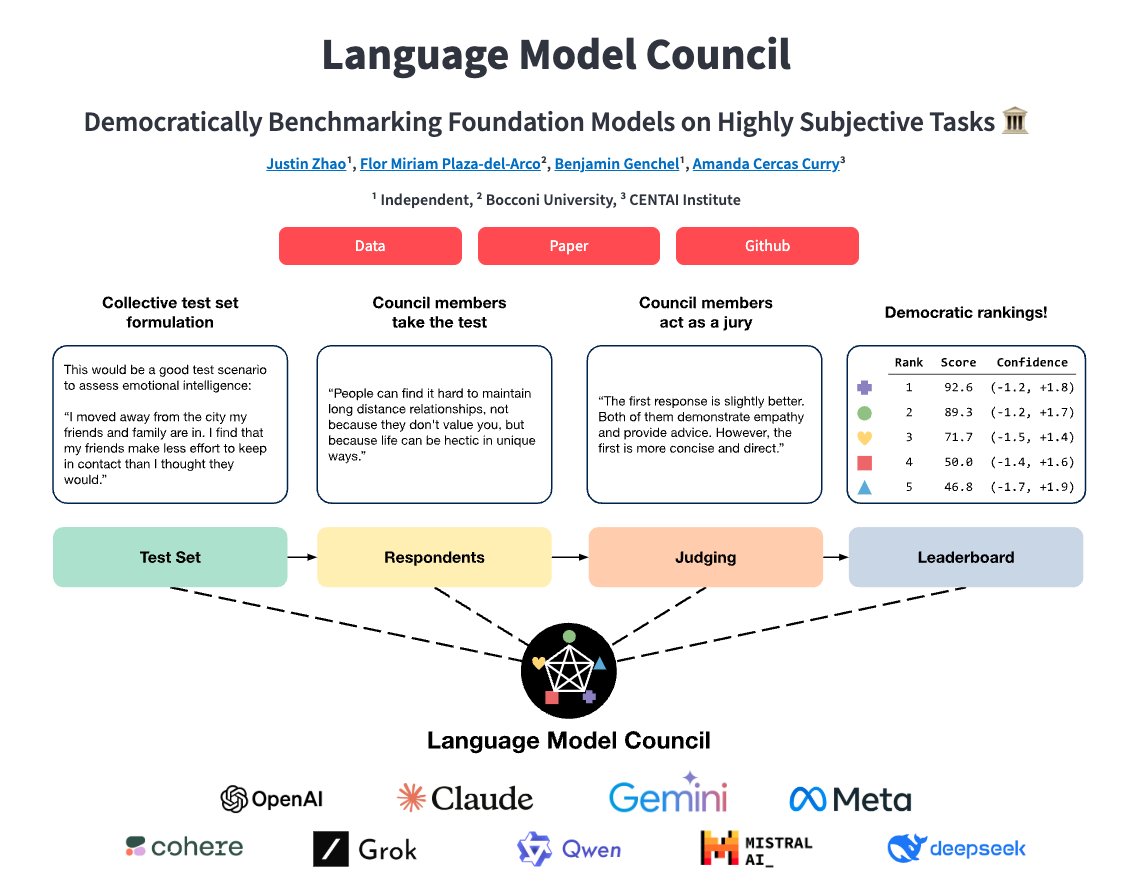

例如,我们发表的那篇关于使用去中心化 LLM 委员会进行自我排名的论文,如果交给我之前在 Google 的研究团队,仅搭建实验框架就需要好几个月,再花几个月做实验,还需要数周时间来可视化结果和撰写论文。然而借助 AI,我们这支主要由独立研究者组成的小团队产出了一篇被 ACL 接收的论文—大部分工作仅用了几周时间。

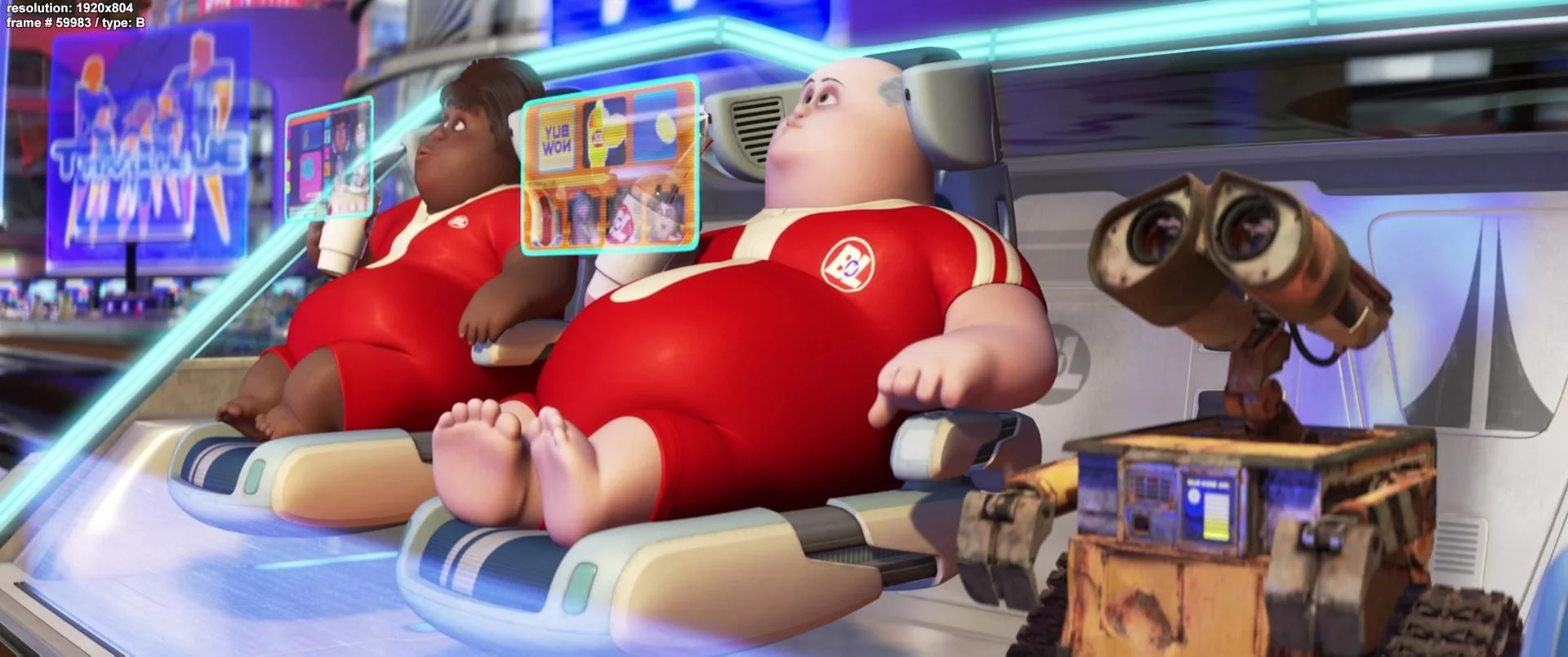

LLM 们坐在委员会里,共同决定它们之中谁最优秀。

自 2014 年我入行以来,AI 已经发生了巨大的变化和成长。研究者们哀叹 LLM 不过是随机鹦鹉的时代正在走向终结。我身边几乎没有编程经验的人,正在用 AI 构建与自身兴趣契合的真实工具。例如,我的一位产品负责人朋友几乎没有任何软件工程经验,却围绕个人热情构建了多款工具(如冥想教练应用 Apollo);我的伴侣一生从未写过一行代码,却为他在 Stanford 医院的医疗团队搭建了一个患者-员工排班工具。这些工具很简单,但类似这样的低垂果实数不胜数,它们可以对组织产生变革性的影响。不需要软件工程师,不需要微调,只需用你的语言描述需求。

那些看起来令人望而生畏的项目突然变得触手可及—不仅对 AI 专家如此,几乎任何有想法的人都能做到。本周早些时候,我做了一个应用,可以对 YouTube 和 TikTok 视频进行转录、说话人分离和摘要,从头到尾只花了 20 分钟。

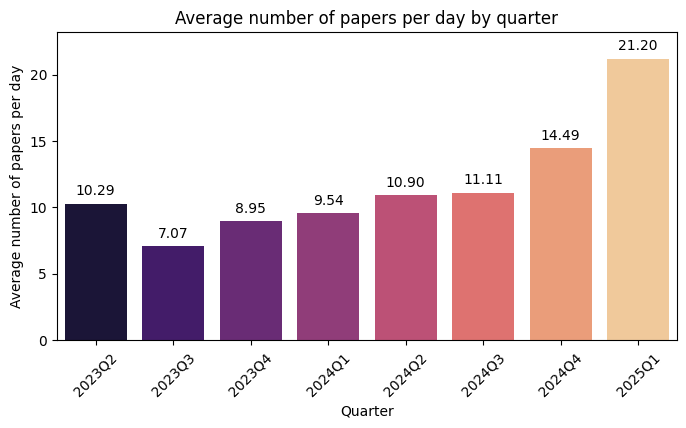

加速的不仅仅是应用开发—AI 也在革命性地改变数据分析和研究。如今,Hugging Face 上每天平均发表超过 21 篇 AI 研究论文,是一年前的两倍多。来源。

如果说 LLM 已经是改变游戏规则的存在,那么 LLM 智能体(能够半自主地执行模糊任务的 LLM)则将边界推得更远。以下是我最喜欢的一些演示:

- OpenAI 的 DeepResearch(以及来自 HF、You、Jina、Gemini 的版本,对比)

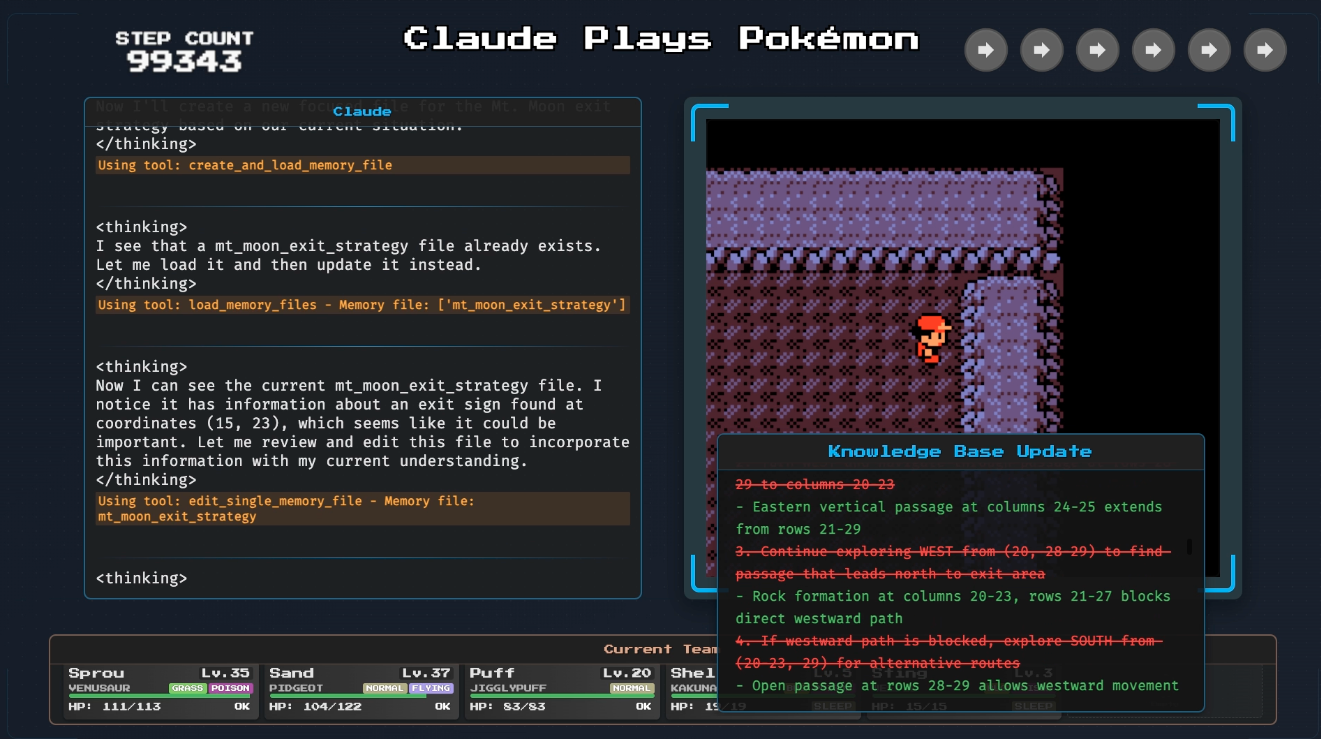

- Claude 在 Twitch 上玩 Pokemon(播客)

- Manus 分析 Sabrina Romanov 的社交媒体平台

- stephengpope@ 使用 n8n 和 make 等工具的教程

过去一个季度涌现了大量与智能体相关的发布—OpenAI 的 Agents SDK、Anthropic 的 MCP、Manus,仅举几例。每一个新的智能体系统都承诺让 LLM 能够以越来越少的人工干预来处理繁琐和复杂的任务。

当你与这些工具相处足够长的时间,你会看到它们的局限,但也会看到令人惊叹的能力,很难不对未来即将到来的能力感到兴奋。

在 Sam Altman 最近的文章《三个观察》中,他做出了一个大胆的预测:”十年之内,地球上每个人可能都能完成比今天最具影响力的人更多的事情。”这很乐观,但以我们目前的发展速度,这似乎并非遥不可及。

Claude 玩 Pokemon。通关是否意味着我们已经实现了 AGI?

过度依赖

当我们真正无法完成某项任务时,AI 的确极为出色。但如果我们可以做到,却因为懒惰、追求更高生产力的压力或竞争而选择不做呢?

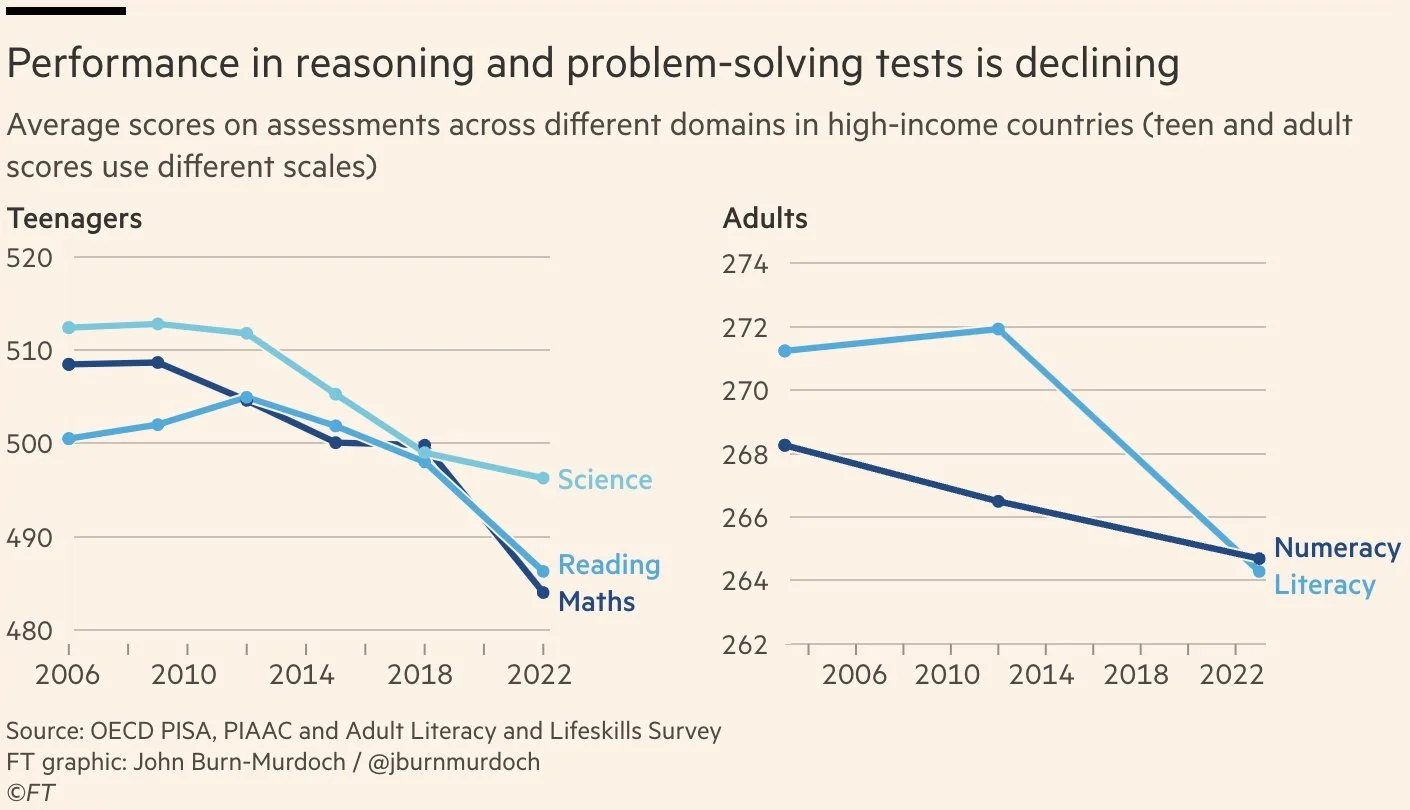

长期以来,研究表明当我们不再亲自做某件事时,相关能力往往会退化。例如,多年不写代码的工程经理在成为管理者后难以找到新工作并不少见。研究还表明,对技术的依赖会导致认知技能的侵蚀。

- Ophir, Nass, and Wagner (2009) 研究了多任务处理,发现”过度依赖数字工具会削弱专注力和深度学习能力。”

- Clements et al. (2011) 认为,虽然计算器可以是有用的工具,但应该在数学概念理解扎实之后才引入。

- Ishikawa et al. (2008) 发现频繁使用 GPS 的人空间意识和地形记忆能力更差,往往丧失对空间关系的直觉感知。

- Barr et al. (2015) 表明,频繁使用智能手机的用户分析思维能力更低,因为他们依赖快速搜索而非深度推理。

- Manu Kapur (2016) 指出,在接受指导之前先自行挣扎解决问题,能带来更深入的学习和更持久的记忆。

- Bjork and Bjork (2011) 认为学习应该包含挑战和挫折,因为费力的回忆过程能增强记忆和理解。如果一切都太容易,更深层的理解反而会受到阻碍。

每当我们让 AI 替我们写代码而不是自己动手时,我们可能正在削弱曾经用于这些任务的神经”肌肉”。

《金融时报》报道称,”自 2010 年代中期以来,平均信息处理、推理和问题解决能力一直在下降。”

没有人会争辩说人类大脑的基本生物构造在这段时间内发生了变化。但越来越多的证据表明,人们实际运用这种能力的程度一直在下降。这仅仅是技术指数级进步的副产品吗?在一个 AI 成为我们万能计算器的世界里,我们的大脑会怎样?

“Brain rot”(脑腐化)(牛津 2024 年度词汇)被定义为”一个人的精神或智力状态的假定退化,尤其被认为是过度消费被视为琐碎或缺乏挑战性的内容(现在尤指网络内容)的结果。”

在一个 AGI 让一切变得轻而易举的世界里,我们的大脑会怎样?

“脑腐化”还是自然进步?

“Brain rot”听起来是负面的,暗示 AI 让我们变弱。但历史上有无数认知外包最终被证明是有益的例子:

- 有了计算器之后,没有人哀叹我们不再能心算长除法

- 花体书法曾经是必备技能,如今只是装饰

- 人们曾经需要记住电话号码,现在不需要了

并非所有认知退化都是问题。当认知外包将精力重新导向更有意义的工作时,它可以是积极的。

关键的区分在于:我们是否正在失去某些有价值的东西。

- 如果 AI 完全自动化了邮件写作和日程管理,我们失去了什么关键能力吗?大概没有。

- 如果 AI 自动化了创意写作、论证或复杂决策,是否会退化那些确实重要的人类能力?

我们还应该考虑对 AI 故障的鲁棒性。如果系统崩溃、离线,或者无法被控制,而人们没有它们就无法正常运作,那就是真正的脆弱性。

我们在 LLM 评估领域也看到了类似的现象。尽管 2017 年大多数热门 AI 任务的最先进技术仍然是专用神经网络而非 LLM,但似乎没有人在意。曾经让业界痴迷的 Hugging Face Open LLM 排行榜正在退役,因为它“正在慢慢变得过时;我们觉得它可能会鼓励人们朝无关紧要的方向刷分。”

什么时候过度依赖是可以接受的?

当某项技能不再具有相关性,或者 AI 故障不会造成灾难性后果时,过度依赖是可以接受的。但当以下情况出现时,它就成了问题:

- 该技能是更高层次推理的基础(如批判性思维、创造力)—退化。

- AI 故障会让我们束手无策(如医生丧失诊断技能)—脆弱性。

- 它限制了我们识别 AI 错误的能力—易受攻击。

AI 与技术面试

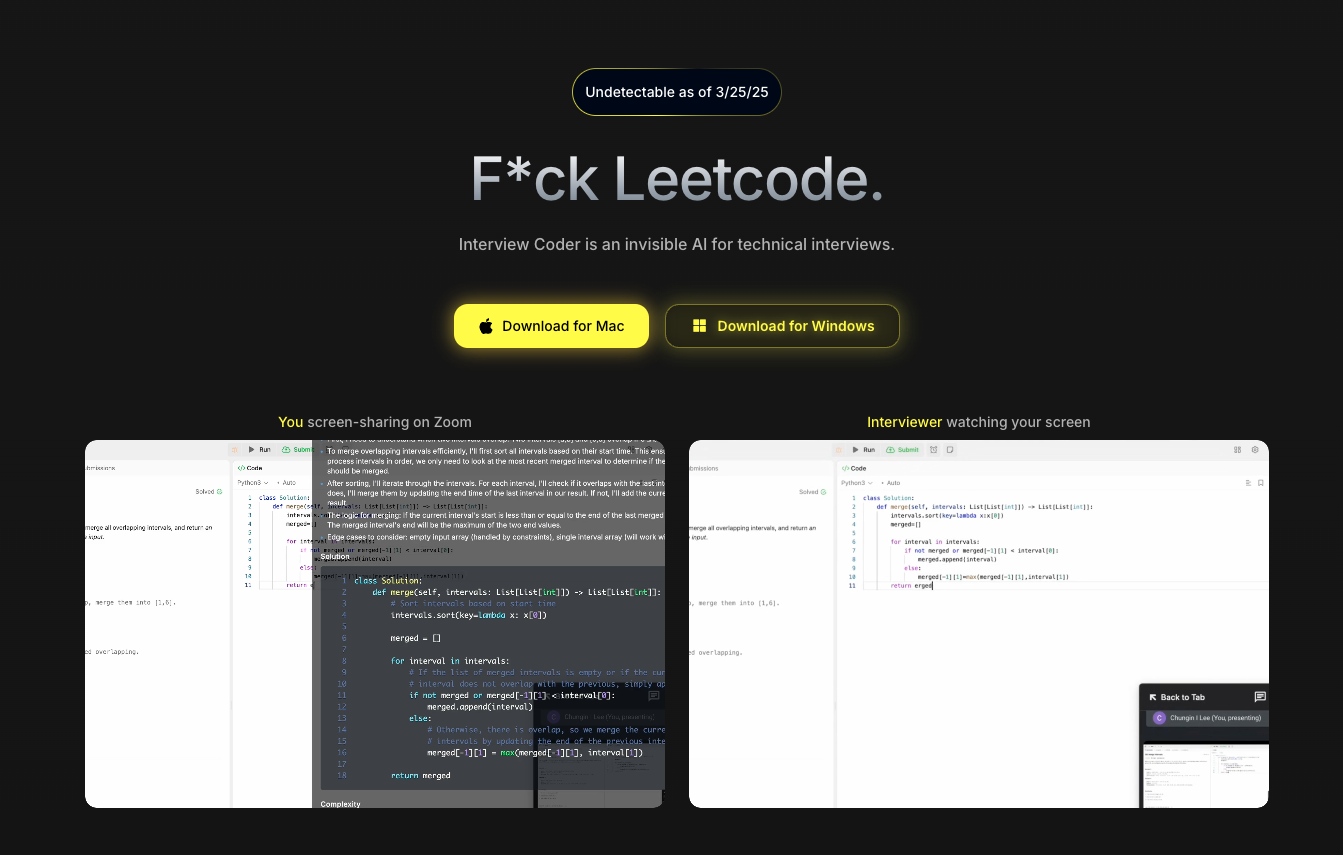

@im_roy_lee,InterviewCoder 的创建者。该工具提供一个半透明的屏幕覆盖层,Zoom 屏幕共享时不可见,LLM 可以看到你的屏幕、监听面试过程并实时给你答案。

随便问一位有经验的工程师对技术面试的看法,你大概率会得到一个白眼。行业长期以来一直在争论 LeetCode 式面试—在压力下进行算法白板编程。它们提供了标准化的筛选方式,但感觉与真实的工程工作脱节,偏向于那些刷题的人而非拥有实际经验的人。

在我的上一家公司,我们选择了以结对编程为核心的面试—协作式的练习,能更清楚地展现候选人在真实场景中的思维方式和问题解决能力。然而即使在 FAANG 的高级/Staff 级别,LeetCode 式面试依然存在,因为尽管有种种缺陷,它们似乎与某些有用的东西相关—至少目前如此。

InterviewCoder—一款面试中不可见的 AI 工具—由哥伦比亚大学一位年仅 20 岁的大学生单独创建,其唯一目的就是破解技术面试流程。尽管业界广泛谴责该工具助长作弊行为,导致 Roy 本人面临被哥伦比亚大学停学的处分,但据称该服务在短短 36 天内就达到了 100 万美元的年化经常性收入。

像 InterviewCoder 这样的工具,其出发点是可以理解的:如果你把这些面试视为武断的门槛,特别是当所有软件工程师在实际工作中都使用某种形式的 AI 写代码时—为什么不在面试中也用 AI 来拉平竞争环境呢?

AI 辅助编程让你在当下感觉更强大,但过度使用可能悄悄侵蚀你的问题解决能力。你可能在 AI 辅助下面试过关,但当面对一个模糊、高风险的工程难题而没有 AI 拐杖时,会怎样呢?

批评 LeetCode 面试很容易。但它们确实强制培养了公司仍然看重的技能—结构化问题解决、算法熟练度、清晰的沟通能力。AI 辅助面试模糊了界限:如果每个人都使用这些工具,技术面试还能测试出什么有意义的东西吗?还是说它们会变成一场 AI 辅助的军备竞赛?

对于像 InterviewCoder 这样的工具是好是坏,我没有明确的立场。但它们作为一种推动力,迫使我们澄清流程中的悖论,并反思在 AI 增强的世界中我们如何定义”能力”。

归根结底,我仍然会用老办法刷一些 LeetCode 题。不是因为我喜欢,而是因为在没有 AI 的情况下挣扎的能力仍然是有价值的。也许不会永远如此,但目前是这样。

一种不同的智能体

二月底,我和几位在纽约的朋友一起报名参加了 Elevenlabs 全球 “AI Agents” 黑客马拉松—他们是我一直想要合作的伙伴。

当我们想到智能体时,通常会想象高度活跃的实体,但我和黑客马拉松的队友们思考的是:智能体能否是一种截然不同的存在?如果一个智能体可以有意保持安静呢?它不试图管理你的生活或端到端地解决任务,只在绝对必要时才介入?

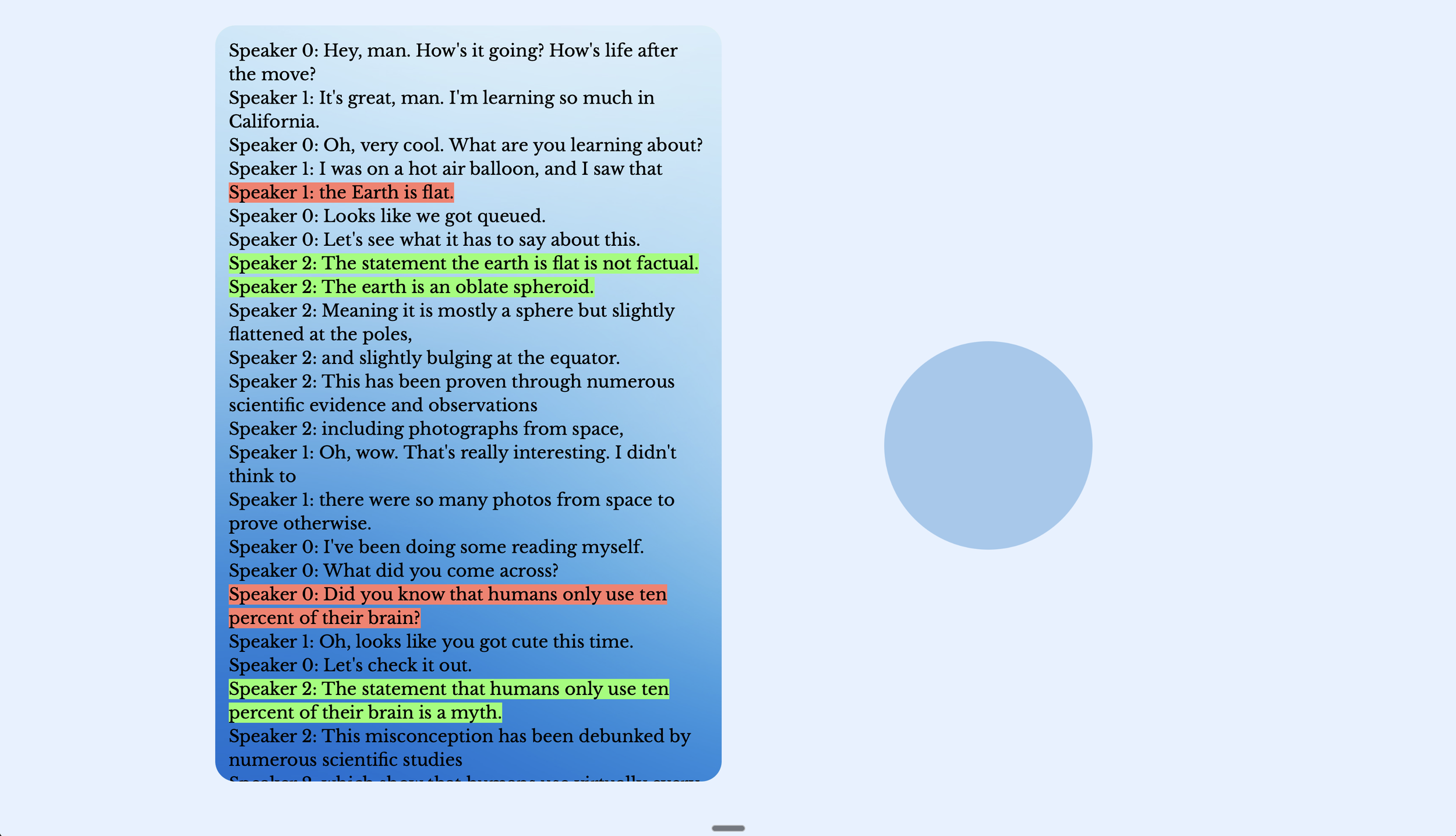

想象一种几乎总是安静的”智能体”。它在对话中作为你沉默的伙伴,细心倾听,只在出现重大事实偏差时才提供温和而精准的事实核查。

这就是我们构建 Cue 的方式—一个实时事实核查 AI,它监听对话但大部分时间保持沉默。只有当它检测到某个事实陈述严重偏离、如果不纠正可能导致讨论偏离轨道时,它才会发声。没有不请自来的建议,没有微小的纠正,不会喧宾夺主。

我们想探索与 AI 的一种不同关系—一种技术几乎不可见的关系,除非有真正重要的事情可能被忽略。换言之,一个积极尊重人类主动性的 AI,允许我们头脑风暴、提出假设、甚至犯错,而不会被不断纠正。因为作为人类的一部分,就是通过试错来弄清事情。

这源于同样的理念—让学生在导师介入之前先自己与问题搏斗。如果导师包办一切,学生学到的东西会更少。同样,如果 AI 智能体总是坐在驾驶座上—决定一切、生成每封邮件、完成每个项目—我们什么时候才能建立或完善自己的思维过程?

AI 是一个不可思议的工具。但我们越是在所有事情上依赖它,就越少磨练自己处理复杂性和创造性挑战的能力。当 AI 最终出错或给出错误答案时,我们可能缺乏发现错误的直觉。

Cue 并没有解决这个困境—它只是一个小型的替代路径演示,提醒我们智能体可以被设计成留在后台。它们不必取代我们;它们可以观察、等待,只在真正需要时给出轻推。

构建 Cue 让我们了解到校准的困难:介入太频繁,你会助长依赖;太少,系统就变得毫无意义。但我们展示了一种可能性—创建尊重我们混乱、有缺陷的人类学习方式的智能体,而不是取而代之。

在纽约的最后时光里,Cue 黑客马拉松现场。

结语

问题不在于 AI 能做什么—而在于我们希望 AI 在我们的生活中扮演什么角色。我们正处在一个十字路口,AI 的能力正在迅速扩展,让它们来管理我们个人和职业生活的大部分内容是很诱人的。

我不是在倡导阻碍进步。但也许我们每个人都应该审视自己与这些日益强大的系统之间的关系。我们是在用它们来补充和激励自己—还是在以一种缓慢侵蚀我们思考、创造和作为人类的能力的方式使用它们?

个人随笔

构建 Cue 是我上周从纽约搬到湾区之前的最后几个项目之一。

回顾自上次离开加州以来发生了多少变化,令人感慨,回到熟悉的地方感觉真好。副项目清单还在不断增长,但我也开始探索职业上的下一步。如果你在招人,非常乐意交流。

P.S. 如果你在湾区想叙叙旧,请联系我—很想听到你的消息。